いまの若者はチャッピー( ChatGPT )が友だちだという。

生成 AI の立ち位置というのは

10年前でいえばスマートフォンであり、

90年代の インターネットや PC といったインフラやツールの類いが置きかわっただけだ。

録音した講義のファイルを「 Google NotebookLM 」に読み込ませて、

「講義の内容をあますことなく仔細に3万字で記述してください」などとプロンプトを打つと、

簡易的な講義のグーグルドキュメントをジェミナイ( Gemini )につくってもらえる。

それをジェミナイのディープリサーチ( Deep Research )にかければいい。

「この講義はアカデミックなものですか? 調査をお願いします」とかで。

しかし、これは、はたして学習なのだろうか。

大学受験や資格試験の勉強であっても、生成 AI は強力無比なものだ。

もはや、ローカル LLM でやる必要はない。

ジェミナイもしくはディープシーク( DeepSeek )でいい。

問題を解くときには「推論プロセスを教えてください」とか(本当の推論プロセスが表示されるわけではないが)、

前提知識がないときは「学習ドメインなしで問題を解くにはどうすればいいでしょうか」とかのプロンプトを打てばいい。

問題演習と AI との壁打ちのスパイラルアップ(螺旋的奏功)が現代なのかもしれない。

こうした「壁打ち」を繰り返すことで知識が強固になるだろう。

このようなフローを使っているヒトはほとんどいないと思うが、

あるていどの素養があれば気づくので、

そのうち主流になっていくのかもしれない。

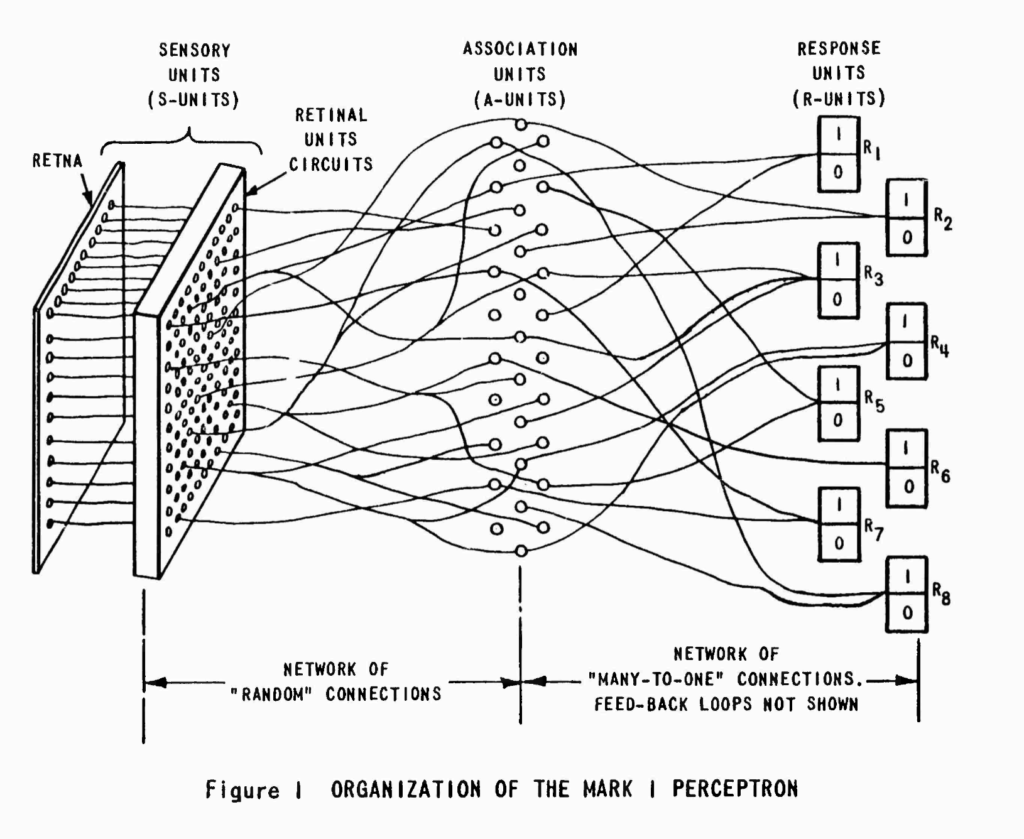

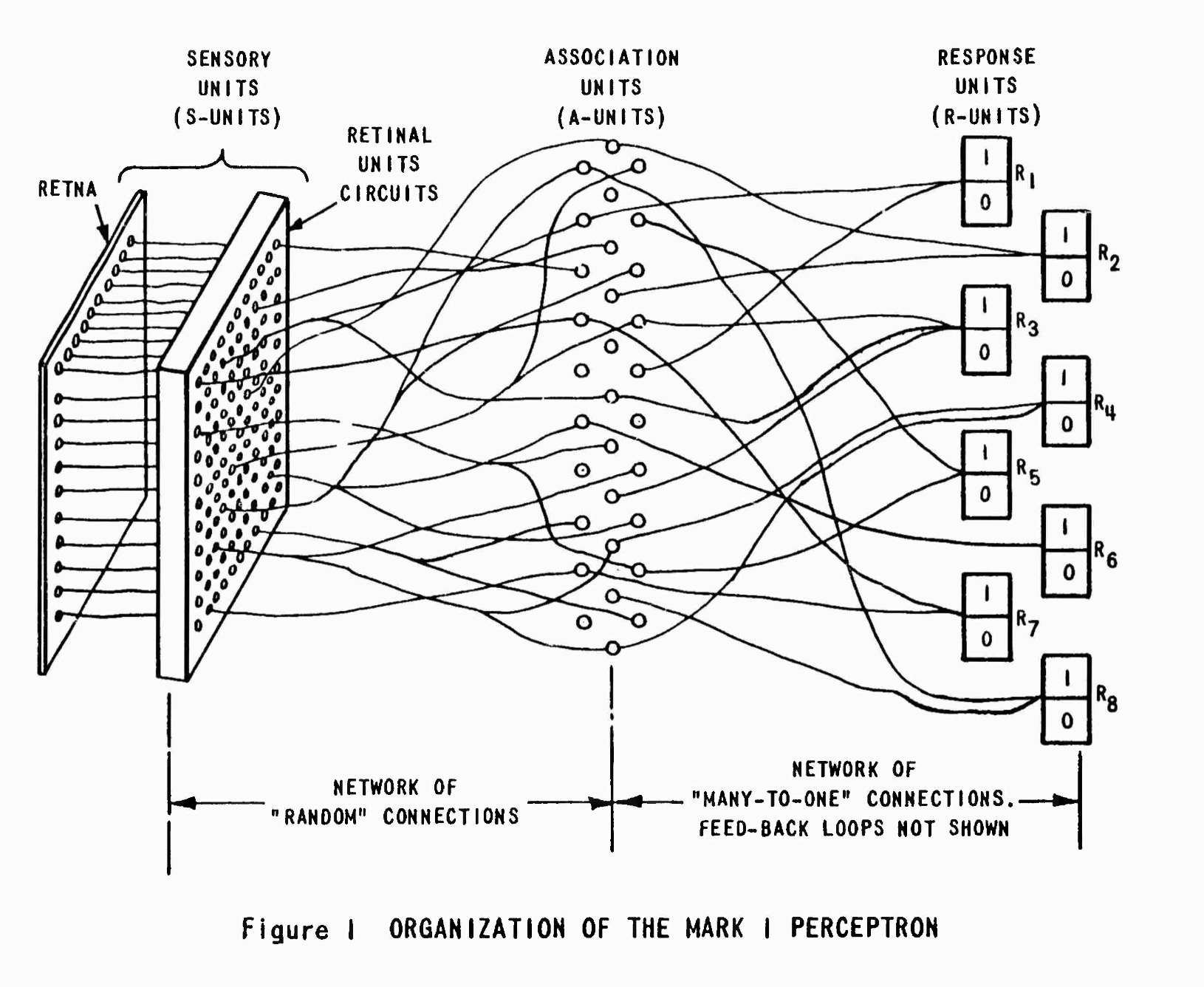

パーセプトロンというセカイではじめて作られた AI がある。

インターネットがブイブイいわせていたときは、

serial experiments lain でも Xanadu (ザナドゥ)といわれていたけど、

イマの時代はパーセプトロンだと思う。

当時は NOeL とかの人工無能だったのにな^ー^

「 Mark I Perceptron 」とかで調べてみてほしい。

これは線形変換しかできず、

非線形やシグモイド、ReLU (レル)関数とかはできないモノだが、

ヒトはパーセプトロンなのだと思う。

まずは調べて、そして AI にきくといいだろう。

専門書や教科書を読み、AI に訊く。

そして、自分自身をバックプロパゲーション(誤差逆伝播法)していく。

オレっちはジジイなので、

AI を使わず、自問自答を繰り返すが^ー^

ちなみに、新聞の社説を要約するように、

AI の回答も、自分の言葉で書いてみるといい。